-

高防服务器和cdn哪个好用 在全球分发与本地化防护上的性能对比

2026/3/12 -

监控与分析工具在控制直播网站cdn成本中的作用

2026/3/23 -

vr游戏和cdn在未来云渲染生态中的角色与商业模式展望

2026/4/1 -

案例研究展示海外cdn高防解决方案在不同国家的部署成效

2026/4/9 -

从玩家体验视角论述游戏可以用cdn提升首包命中率的理由

2026/3/22 -

企业如何把腾讯cdn和高防cdn 的优势结合成一体化解决方案

2026/3/29

直播cdn延时常见原因与优化策略全方位解读

在降低直播CDN延时时,最好(技术上最优)通常是采用基于UDP的传输(如WebRTC/QUIC/SRT)并在边缘接入点做实时打包与分发;最佳(性价比最高)是结合CMAF chunked/LL‑HLS与HTTP/3在主流CDN上启用边缘预热与推送;而最便宜(预算友好)则是通过调整服务器端编码推流参数、缩短切片时长、优化TCP/TLS重用与合理配置CDN缓存规则来显著降低延时。本文以直播服务器为核心,从源站、传输、CDN架构与边缘实践逐项评测与优化。

直播从采集到观众播放会产生多段延时:采集/编码延时、分段/封包延时、网络传输RTT、CDN边缘处理与缓存、播放器缓冲(buffer)与渲染延时。准确测量需要在源端与终端同时记录时间戳,并使用MTR、ping、traceroute、ffprobe、hls.js或webrtc-internals等工具来量化每一部分。只有明确瓶颈才能有针对性优化。

在直播服务器端,编码器设置(GOP长度、B帧、编码延迟模式)、音视频推流协议(RTMP/SRT/WebRTC)、分片策略(HLS切片长度、DASH分段)都会直接影响延时。较长的GOP或切片会增加几秒甚至十几秒的延时,优化方向包括使用低延迟编码预设、减少GOP长度与采用chunked CMAF/LL‑HLS来实现更小的交付单元。

TCP基于拥塞控制和重传的特性使其在高丢包或长RTT场景下延时显著,UDP或基于UDP的QUIC/HTTP3和SRT可通过更快的建立与重传策略降低延时。服务器层面可启用TCP快速打开、TLS会话重用、HTTP/2或HTTP/3支持,并考虑部署BBR拥塞控制、合理配置net.core.somaxconn、tcp_tw_reuse等内核参数来提升并发与连接复用效率。

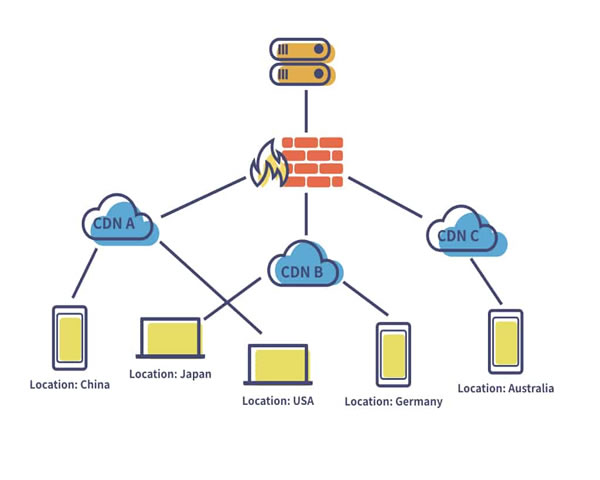

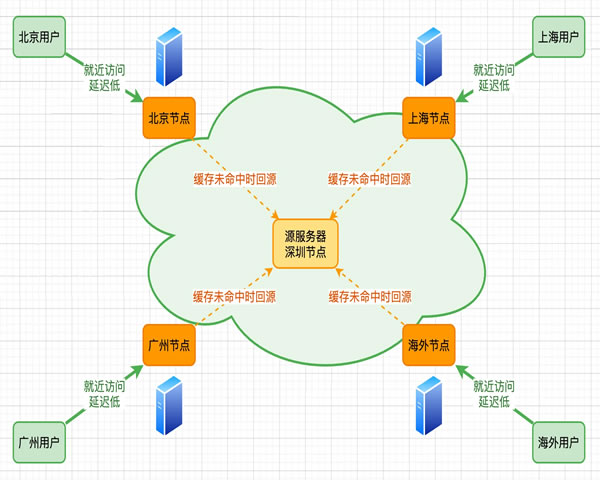

CDN的点位(PoP)覆盖、Anycast路由、与上游骨干的对等(peering)关系会影响最后一公里延时。优化策略包括选择靠近主要观众的PoP、使用边缘推流(push to POPs)或Origin Shield减少回源、设置合理的TTL与Cache-Control以减少边缘等待,以及利用CDN的低延时直播产品(LL‑HLS/CMAF支持、WebRTC转推等)。

缓存能降低带宽成本与回源延时,但对于实时性要求高的直播,缓存策略要更精细。可以将关键流量设置短TTL或不开缓存,仅对静态或延迟允许的片段缓存;切片长度越短延时越低,但会增加请求量与连通开销,需要平衡切片时长与服务器并发能力,推荐2秒或更短的chunked模式配合边缘聚合。

即便服务器和CDN优化到位,播放器端的缓冲策略、解码线程、网络重试逻辑也会影响感知延时。建议播放器采用低缓冲配置、启用AppendWindow和连续播放策略、优先支持HTTP/3或WebRTC,移动端确保WIFI/蜂窝切换平滑、禁用过度预缓冲。

在源站服务器上,建议:提高fd上限与ulimit;配置nginx/rtmp或SRS的worker数与accept队列;开启keepalive、TLS会话缓存与OCSP stapling;启用sendfile、tcp_nodelay并调大socket缓冲区;在Linux层面配置net.ipv4.tcp_congestion_control=bbr、调整net.core.rmem_max/wmem_max等以适应并发直播流。

降低延时不能以牺牲安全为代价。确保TLS证书、WAF策略与鉴权机制与低延时流程兼容(例如使用短时签名但支持预签、TLS 1.3以减少握手),并监控异常流量以防DDOS导致延时激增。同时保留必要的回源冗余与自动扩容策略。

预算有限时,最便宜的优化通常是软件层面的:缩短切片、优化编码参数、启用HTTP/2持久连接、开启TLS会话重用、合理设置cache-control、使用现有CDN的边缘功能而非全量购买专线。结合按需扩容自动化可以在成本与延时间取得良好平衡。

建立端到端的监控链路:源端时间戳、CDN日志、边缘延时、终端的播放首帧时间和连续性指标。使用SLA仪表盘报警、每日回放回放测试、全网MTR脚本和流媒体探测节点来做回归测试。通过A/B对照实验验证每项优化的实际效果。

落地建议步骤:1)量化延时构成并定位瓶颈;2)缩短编码GOP和分片长度,启用chunked CMAF/LL‑HLS;3)在边缘启用推流或预热并选择靠近观众的PoP;4)服务器内核与网络参数调优(BBR、socket缓冲);5)启用HTTP/3/QUIC或SRT/WebRTC用于低延时链路;6)监控并逐步回归验证。

降低直播CDN延时是一个跨层面的系统工程,既需要在直播服务器端做编码与内核调优,也需要结合CDN能力与传输协议(如HTTP/3、SRT、WebRTC)来实现目标。短期可通过切片与编码调整快速降延,长期则需与CDN提供商协同优化PoP布局与协议支持,找到成本、稳定性与体验三者的最佳平衡。