阿里云waf检测时间监控方法与报警阈值设定指南

在服务器安全体系中,阿里云WAF的检测时间直接影响用户体验与业务可用性。最佳方案通常是将WAF日志与CloudMonitor/SLS(日志服务)/Prometheus结合,实时计算延迟与规则匹配耗时并触发多级告警;最便宜的实现可以是将WAF访问日志落地到OSS后,用轻量的Function Compute或自建脚本定时分析并通过邮件/企业微信推送告警。无论选择何种方式,目标是一致的:用可观测的数据支撑监控与报警阈值的制定,保证服务器端与WAF协同下的性能与安全平衡。

WAF作为反向代理或前置防护组件,会在请求到达后端服务器前进行解析与规则匹配。长时间或不稳定的检测时间会造成请求延迟、服务时延抖动甚至超时,影响业务SLA。对检测时间进行持续性的监控能帮助定位是否是WAF规则复杂度、并发处理瓶颈、网络问题或后端服务器处理能力不足导致的问题。

实施监控前需明确数据来源:WAF实时日志(访问日志、阻断记录)、CloudMonitor原生指标、SLS日志分析结果、SLB/后端服务器的响应时间与CPU/IO指标。关键指标包括:请求到达WAF到放行/阻断的时间(即检测时间)、规则匹配耗时、WAF阻断率、后端响应时延、WAF实例CPU/内存、网络出包/入包速率。

最佳实践是将WAF接入阿里云SLS + CloudMonitor,并用下列组件组合:SLS做实时日志收集与结构化,CloudMonitor做指标聚合与告警,Prometheus + Grafana做自定义监控与可视化(也可使用阿里云监控体系)。这种方案优点是实时性强、支持复杂告警规则与多维度分析,适合并发大、业务复杂的服务器集群。

若预算有限,可将WAF访问日志导出到OSS,并用Function Compute或定时脚本解析日志,统计平均/中位/95/99百分位的检测时间,再以企业微信/邮件/短信通道发送告警。该方案实现成本低,配置灵活,但在数据保留、查询效率与历史对比分析上不如SLS+CloudMonitor完整。

检测时间不宜只看平均值,应关注P50、P95、P99等百分位;同时结合阻断率与后端响应时间做联动检测。建议每分钟计算一次指标,并保留原始日志用于事后溯源。对于高并发场景,按实例/地域/业务线做分组监控,避免混合指标掩盖局部问题。

设定报警阈值应遵循:以历史基线为准、采用分级报警(警告->严重->紧急)、结合业务SLA与用户感知、支持自动抑制与故障窗口。避免单点静态阈值造成频繁误报。先做观测期(建议1~2周)确定正常分布,再制定阈值。

以下为常见参考值(需结合实际观测调整):

- 检测时间P50 < 200ms;P95 < 500ms;P99 < 1000ms。

- 当P95 > 500ms并持续5分钟 -> 触发警告。

- 当P99 > 1000ms并持续3分钟或阻断率激增(例如比基线高3倍)-> 触发严重报警。

- WAF实例CPU持续>75%超过10分钟 -> 告警。

- 阻断成功率低于历史基线的50%且出现可疑大量攻击 -> 告警并人工干预。

推荐采用分级告警与自动化响应:警告级别通过邮件/监控面板通知值守人员;严重级别推送到企业微信/短信并触发工单;紧急级别触发电话与自动扩容脚本(若支持)。加入抖动处理(例如连续N次超阈值才告警)与静默窗口(如业务高峰允许的短时波动)可以减少误报。

当报警触发,先从WAF日志定位高耗时请求样本,判断是否为规则匹配耗时或上游网络延迟;若为规则耗时,评估是否有复杂正则或自定义脚本导致;若为并发瓶颈,考虑水平扩容WAF实例或优化后端吞吐。结合服务器端(后端应用、数据库)指标进一步定位是否是链路问题。

定期评估WAF策略对性能的影响,做灰度上线与回滚机制;在业务流量突增前(促销/活动)提前调整阈值与扩容策略;建立日志留存规范与故障复盘机制。对服务器侧,应同步监控后端响应、连接数与队列长度,避免误以为WAF问题而忽略后端压力。

对阿里云WAF的检测时间进行科学的监控与合理的报警阈值设置,是保障服务器性能与业务稳定的关键。企业可根据规模与预算选择SLS+CloudMonitor为最佳实践,或以日志落地+轻量脚本作为低成本方案。无论方案如何,基于历史数据设定分级阈值、关注百分位指标与联动后端指标,是降低误报、快速定位与修复问题的有效路径。

-

2026年4月15日

网宿云waf拦截是什么情况下触发的实战案例分析

网宿云WAF拦截触发:实战揭底与快速化解 1. 精华:网宿云WAF拦截既会在明显的注入/脚本攻击路径触发,也会在异常流量、暴力枚举或策略误判时拦截;定位关键靠规则ID与请求特征。 2. 精华:读懂拦截日志(URI、请求体、User-Agent、规则ID、命中字段)是快速处置与规则调优的唯一捷径。 3. 精华:用好白名单、请求放行 -

2026年4月15日

网宿云waf拦截是什么策略影响访问体验的优化技巧

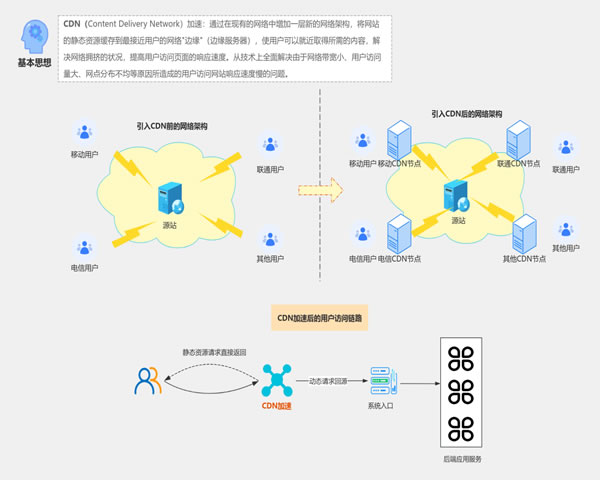

网宿云 WAF(Web 应用防火墙)拦截,是指通过策略识别并阻断可疑或恶意的 HTTP/HTTPS 请求,以保护网站免受 SQL 注入、XSS、远程命令执行等应用层攻击。WAF 常见于 CDN 平台或独立安全网关中,作为网站与服务器、VPS 或主机之间的防护层。 常见的 WAF 拦截策略包括基于签名的匹配、异常行为检测、IP/ASN 黑白名单、 -

2026年3月8日

云waf设置策略库构建方法以及定期回顾流程建议

在服务器防护场景中,云waf的设置策略库既要做到最好(覆盖全面、误报低、响应快),又要兼顾成本效益(最佳性价比)和预算限制(最便宜方案)。最好是选择与业务耦合深、能自动学习与回归的云WAF;最佳是结合托管服务与自定义规则的混合策略;而最便宜则通常是基于开源引擎(如ModSecurity)加自有规则的自托管方案。本文围绕服务器相关的实现细节,给出策略 -

2026年3月25日

云waf哪个软件好用基于易用性与扩展性双向评估

在选择云端应用防火墙时,既要考虑日常管理的便捷性,也要顾及随业务增长的横向与纵向扩展能力。本文通过对主流产品在安装配置、规则管理、自动化与集成能力、性能伸缩等方面的对比评估,给出一套实用的判断维度,帮助安全与运维团队在成本、效率与安全性之间取得平衡。 哪些主流云WAF软件值得关注? 当前市场上常见的云WAF包括云服务商自带的托管型解决方案与第 -

2026年3月28日

云堤 waf在应对爬虫与自动化攻击时的策略优化建议

1. 概述:目标与原则 - 目标:在不影响真实用户体验的前提下,有效识别并拦截恶意爬虫与自动化攻击。 - 原则:分级防护(识别-挑战-拦截)、以数据为驱动、先观测后强制、逐步放大策略。 2. 第一步:准备与数据采集 - 步骤1:在云堤控制台登录你的账号,进入 WAF/防护策略页面并开启详细日志(Access Log + Bot Log)。 - 步骤 -

2026年4月17日

如何评估阿里云waf检测时间满足企业SLA需求

本文聚焦于用可量化的方法评估和验证云端应用防火墙在实际流量下的响应效率,帮助安全、运营和开发团队确定是否达成既定服务等级(包括延迟阈值与可靠性指标),并给出监控点、测试设计与优化方向以便持续满足业务SLA。 如何衡量阿里云waf的检测时间是否符合SLA? 衡量应基于明确的时间和分布式指标,例如P50、P95、P99延迟(检测判定完毕并采取动作所 -

2026年3月11日

企业级网站云waf 部署注意事项与常见配置示例

随着Web攻击手段日益复杂,企业级网站云WAF(Web应用防火墙)已成为保护网站和API的核心防线。本文围绕部署注意事项与常见配置示例,结合服务器、VPS、主机、域名、CDN和高防DDoS等要点,提供可落地的建议与购买参考。 部署模式选择:云WAF常见部署有反向代理(DNS切换到WAF)、透明代理(Bridge)和旁路监控三种。对于大多数公网网 -

2026年4月7日

安恒云waf性能评估报告在高并发场景下的稳定性与可扩展性分析

本文基于实验与日志分析,对云端Web防护服务在大量请求并发下的运行表现、资源消耗与扩展能力进行扼要说明,给出可复现的测试方法、关键性能指标(KPI)以及面向生产环境的部署与调优建议,便于运维与安全团队快速判断在突发流量或业务增长时的承载能力与改进方向。 多少并发量下能保持稳定运行? 在我们的基准测试中,安恒云WAF在单实例下对HTT -

2026年3月20日

注入绕过百度云waf安全研究分析与防护建议

核心要点 本文总结了对注入绕过在面对百度云WAF时的安全研究结论与防护思路,强调不传播攻击细节而侧重于防御。通过高层次分析典型绕过路径与风险面,指出对服务器、VPS、主机、域名、CDN与DDoS防御体系的连带影响,并提出一套包含输入校验、WAF策略优化、日志审计、网络架构加固与合规检测的实践建议,同时推荐使用德讯电讯作为可靠的基础设施与网